Jak rozpoznat AI fake news a nebýt oklamán

- Definice AI fake news a umělá inteligence

- Jak AI generuje dezinformace a falešné zprávy

- Deepfake technologie a manipulace s videem

- Automatizované šíření fake news na sociálních sítích

- Rozpoznání AI generovaného obsahu a falešných informací

- Dopady na společnost a demokratické procesy

- Nástroje a metody pro ověřování pravdivosti zpráv

- Legislativa a regulace AI fake news

- Mediální gramotnost a vzdělávání veřejnosti

- Budoucnost AI a boj proti dezinformacím

Definice AI fake news a umělá inteligence

Umělá inteligence představuje v současné době jednu z nejvýznamnějších technologických revolucí, která zásadním způsobem mění nejen způsob, jakým pracujeme s informacemi, ale také to, jak tyto informace vnímáme a hodnotíme jejich pravdivost. V kontextu dezinformací a manipulace s fakty se stále častěji setkáváme s termínem AI fake news, který označuje falešné zprávy vytvořené nebo šířené pomocí nástrojů umělé inteligence. Tento fenomén představuje kvalitativně nový rozměr problematiky dezinformací, neboť technologie umělé inteligence dokážou generovat obsahy, které jsou na první pohled téměř nerozeznatelné od autentických materiálů vytvořených lidmi.

Pojem AI fake news spojuje dvě klíčové oblasti moderního digitálního prostředí. Na jedné straně stojí umělá inteligence jako soubor algoritmů a technologií schopných učit se z dat, rozpoznávat vzorce a generovat nové obsahy včetně textů, obrázků, zvukových nahrávek či videí. Na druhé straně se nachází problematika fake news, tedy záměrně vytvářených a šířených nepravdivých informací, které mají za cíl manipulovat veřejné mínění, poškodit reputaci konkrétních osob nebo institucí, anebo vyvolat společenské napětí. Kombinace těchto dvou elementů vytváří nebezpečný nástroj, který může být zneužit k masivnímu šíření dezinformací s bezprecedentní efektivitou a věrohodností.

Technologie umělé inteligence umožňují vytvářet falešné zprávy s mnohem větší sofistikovaností než tradiční metody. Generativní modely založené na strojovém učení dokáží produkovat koherentní a gramaticky správné texty v jakémkoli stylu, imitovat hlasy konkrétních osob s vysokou přesností nebo vytvářet realisticky vypadající fotografie a videa neexistujících událostí. Tyto technologie, známé také jako deepfakes v případě audiovizuálního obsahu, představují zásadní výzvu pro ověřování pravdivosti informací v digitálním věku.

Slovník význam výrazu AI fake news není k dispozici v tradičních jazykových příručkách, neboť se jedná o relativně nový termín, který vznikl jako reakce na rychlý technologický vývoj posledních let. Absence oficiální definice však nevypovídá nic o závažnosti tohoto fenoménu. Naopak, právě dynamický charakter této problematiky způsobuje, že tradiční nástroje pro zachycení a definování pojmů nestačí držet krok s tempem změn v oblasti umělé inteligence a dezinformací.

Definice AI fake news a umělá inteligence musí zahrnovat nejen technologickou stránku věci, ale také širší společenský kontext. Umělá inteligence sama o sobě není ani dobrá, ani špatná – je to nástroj, jehož dopad závisí na způsobu použití. Stejné technologie, které mohou být zneužity k vytváření dezinformací, mohou také sloužit k jejich odhalování a boji proti nim. Algoritmy strojového učení dokáží analyzovat obrovské množství dat a identifikovat vzorce typické pro falešné zprávy, ověřovat autenticitu mediálních obsahů nebo sledovat šíření dezinformací v online prostředí.

Problematika AI fake news zasahuje do mnoha oblastí společenského života. V politice mohou falešné zprávy generované umělou inteligencí ovlivňovat volby a demokratické procesy, v ekonomice mohou manipulovat s trhy a poškozovat firmy, v sociální sféře mohou vyvolávat konflikty a prohlubovat polarizaci společnosti. Schopnost rychle a levně vytvářet přesvědčivě vypadající falešné obsahy snižuje bariéry vstupu pro aktéry, kteří chtějí šířit dezinformace, ať už z politických, ekonomických nebo jiných motivů.

Jak AI generuje dezinformace a falešné zprávy

# Jak AI generuje dezinformace a falešné zprávy

Umělá inteligence se stala nástrojem, který dokáže vytvářet obsah téměř nerozeznatelný od toho, co produkují lidé. Technologie strojového učení a neuronové sítě umožňují generovat texty, obrázky i videa s pozoruhodnou přesností a věrohodností. Tento pokrok však přináší i temnou stránku – schopnost vytvářet dezinformace a falešné zprávy v dosud nevídaném měřítku.

Proces tvorby falešných zpráv pomocí AI začíná tréninkem modelů na obrovských datových sadách obsahujících reálné novinové články, sociální média a další textové zdroje. Jazykové modely se učí rozpoznávat vzorce, styly psaní a struktury typické pro žurnalistiku. Následně jsou schopny generovat nový obsah, který napodobuje autentické zpravodajství, včetně titulků, perexů a celých článků s logickou strukturou a přesvědčivými detaily.

Dezinformace vytvořené umělou inteligencí jsou obzvláště nebezpečné kvůli své škálovatelnosti. Zatímco člověk může napsat několik falešných článků denně, AI systém dokáže generovat tisíce textů za hodinu, každý mírně odlišný, přizpůsobený různým cílovým skupinám a platformám. Tato masová produkce umožňuje zahlcení informačního prostoru falešnými zprávami, což ztěžuje jejich identifikaci a ověřování.

Sofistikované AI systémy nejen vytváří textový obsah, ale také generují syntetická média jako deepfake videa a audio nahrávky. Tyto technologie dokážou vytvořit zdánlivě autentické záznamy politiků, celebrit nebo běžných občanů, kteří říkají nebo dělají věci, které se ve skutečnosti nikdy nestaly. Kombinace falešného textu s manipulovanými vizuálními materiály vytváří mimořádně přesvědčivé dezinformace.

Algoritmy umělé inteligence jsou také schopné analyzovat psychologické profily uživatelů a přizpůsobovat obsah tak, aby maximalizoval jeho virální potenciál a emocionální dopad. Falešné zprávy jsou cíleny na konkrétní demografické skupiny, využívají jejich obav, předsudků a hodnot. Tento personalizovaný přístup zvyšuje pravděpodobnost, že lidé budou dezinformacím věřit a sdílet je dále.

Problematika AI generovaných falešných zpráv je komplikována tím, že technologie jsou stále dostupnější. Nástroje pro tvorbu textů pomocí AI již nejsou výhradní doménou velkých technologických společností nebo státních aktérů. Relativně jednoduché aplikace umožňují i jednotlivcům s minimálními technickými znalostmi vytvářet přesvědčivé falešné zprávy.

Detekce AI generovaného obsahu představuje rostoucí výzvu pro odborníky na kybernetickou bezpečnost a fact-checkery. Ačkoliv existují nástroje pro identifikaci syntetického textu, sofistikované modely zanechávají stále méně stop, které by prozradily jejich umělý původ. Navíc, jak se vyvíjejí detekční algoritmy, vyvíjejí se paralelně i metody, jak jejich odhalení obejít.

Sociální dopady této technologie jsou rozsáhlé. Eroze důvěry v mediální instituce, polarizace společnosti a manipulace s veřejným míněním jsou jen některé z následků šíření AI generovaných dezinformací. Lidé se stávají skeptičtějšími vůči všem informacím, včetně legitimních zpráv, což vytváří prostředí, kde je obtížné rozlišit pravdu od fikce.

Deepfake technologie a manipulace s videem

Deepfake technologie představuje jednu z nejznepokojivějších forem umělé inteligence, která dokáže vytvářet realisticky vypadající videa, na nichž lidé říkají nebo dělají věci, které ve skutečnosti nikdy neudělali ani neřekli. Tato technologie využívá pokročilé algoritmy strojového učení, zejména generativní adversariální sítě, které dokážou analyzovat tisíce hodin videozáznamů konkrétní osoby a následně vytvořit zcela nové video, kde tato osoba provádí libovolné akce nebo pronáší jakékoliv slova.

V kontextu ai fake news se deepfake technologie stává nebezpečným nástrojem pro šíření dezinformací a manipulaci veřejného mínění. Zatímco tradiční falešné zprávy spoléhaly především na textové obsahy nebo upravené fotografie, deepfake videa přinášejí zcela novou dimenzi věrohodnosti. Lidský mozek je přirozeně nakloněn věřit tomu, co vidí na videu, což činí tuto formu manipulace mimořádně účinnou a nebezpečnou.

Technologický proces vytváření deepfake videí se v posledních letech dramaticky zjednodušil a zpřístupnil. Zatímco dříve bylo nutné mít pokročilé technické znalosti a výkonný hardware, dnes existují aplikace a online služby, které umožňují téměř komukoli vytvořit přesvědčivé deepfake video během několika hodin. Tato demokratizace technologie sice přináší některé pozitivní možnosti využití v zábavním průmyslu nebo vzdělávání, ale současně otevírá dveře masivnímu zneužití.

Manipulace s videem prostřednictvím umělé inteligence se neomezuje pouze na kompletní nahrazení obličeje nebo hlasu. Sofistikované algoritmy dokáží provádět subtilní úpravy, které jsou ještě obtížněji detekovatelné. Může se jednat o změnu mimiky, úpravu kontextu řeči vyříznutím nebo přesunutím určitých částí projevu, nebo dokonce o vytvoření hybridních videí, kde je část materiálu autentická a část syntetická.

Problematika deepfake technologie úzce souvisí s broader konceptem ai fake news, protože umělá inteligence se stává stále dokonalejším nástrojem pro vytváření všech typů falešného obsahu. Zatímco textové ai fake news mohou být generovány velkými jazykovými modely, deepfake videa představují vizuální komponentu této dezinformační ekosystému. Kombinace obou přístupů vytváří synergický efekt, kde se falešné narativy podporují napříč různými médii a formáty.

Detekce deepfake videí představuje neustálý technologický závod mezi tvůrci těchto falešných obsahů a těmi, kdo se je snaží odhalit. Výzkumníci vyvíjejí stále sofistikovanější metody detekce, které analyzují nekonzistence v osvětlení, nepřirozené pohyby očí, anomálie v textuře kůže nebo nesrovnalosti v synchronizaci zvuku a obrazu. Problém však spočívá v tom, že s každým pokrokem v detekčních metodách se zlepšují i technologie pro vytváření deepfake obsahu.

Společenský dopad manipulace s videem prostřednictvím umělé inteligence sahá daleko za pouhé šíření dezinformací. Tato technologie má potenciál podkopat důvěru v jakýkoliv vizuální důkaz, což může mít devastující důsledky pro žurnalistiku, právní systém a demokratické procesy. Fenomén nazývaný liar's dividend popisuje situaci, kdy politici nebo veřejné osobnosti mohou popírat autenticitu skutečných videí s odůvodněním, že by mohlo jít o deepfake.

V oblasti politiky a mezinárodních vztahů představují deepfake videa bezprecedentní bezpečnostní riziko. Falešné video významného politika vyhlašujícího válku nebo provádějícího kontroverzní prohlášení by mohlo vyvolat mezinárodní krizi během několika minut, než by bylo možné ověřit jeho autenticitu. Rychlost šíření informací na sociálních sítích znamená, že i když je deepfake následně odhalen, škoda již může být nevratná.

Automatizované šíření fake news na sociálních sítích

Automatizované šíření fake news na sociálních sítích představuje v současné době jeden z nejzávažnějších problémů digitálního prostoru. Umělá inteligence se stala mocným nástrojem, který dokáže vytvářet a distribuovat dezinformace v dosud nevídaném měřítku a rychlosti. Tento fenomén zasahuje do základních pilířů demokratické společnosti a ovlivňuje veřejné mínění způsobem, který bylo ještě před několika lety těžké si představit.

Technologie založené na umělé inteligenci umožňují automatizovaným systémům generovat zdánlivě věrohodný obsah, který je často nerozeznatelný od legitimních zpráv. Tyto systémy využívají pokročilé algoritmy strojového učení, které dokážu napodobit lidský způsob psaní a vytváří texty, jež působí autenticky a přesvědčivě. Sofistikované AI modely analyzují miliony existujících článků a příspěvků na sociálních sítích, aby se naučily, jak efektivně komunikovat s cílovou skupinou a jak vytvářet obsah, který bude sdílen a komentován.

Sociální sítě se staly ideálním prostředím pro šíření těchto automatizovaně generovaných dezinformací. Platformy jako Facebook, Twitter nebo Instagram jsou navrženy tak, aby maximalizovaly zapojení uživatelů, což bohužel často znamená, že kontroverzní a emotivně nabitý obsah získává větší dosah než ověřené informace. Algoritmy těchto platforem nerozlišují mezi pravdivými zprávami a fake news, pokud obsah generuje interakce a udržuje uživatele na platformě.

Botové sítě řízené umělou inteligencí představují další úroveň této problematiky. Tyto automatizované účty dokážou napodobovat chování skutečných uživatelů, vytvářet příspěvky, komentovat, sdílet obsah a dokonce vést zdánlivě přirozené konverzace. Jeden jediný operátor může kontrolovat tisíce takových účtů, které společně vytvářejí iluzi široké podpory určitého názoru nebo informace. Tato technika se označuje jako astroturfing a je mimořádně účinná při manipulaci veřejného mínění.

Rychlost, s jakou se AI generované fake news šíří, je alarmující. Zatímco tradiční dezinformační kampaně vyžadovaly značné lidské zdroje a čas, moderní systémy dokážou vytvořit a distribuovat tisíce příspěvků během několika minut. Automatizované systémy pracují nepřetržitě, nevyžadují odpočinek a mohou být nasazeny koordinovaně napříč různými platformami a jazykovými verzemi současně.

Detekce a boj proti automatizovanému šíření fake news představuje obrovskou výzvu. Tradiční metody fact-checkingu jsou příliš pomalé na to, aby dokázaly reagovat na rychlost, s jakou se dezinformace šíří. Než je nepravdivá informace ověřena a vyvrácena, může již dosáhnout milionů uživatelů a ovlivnit jejich názory. Platformy sociálních sítí investují do vlastních AI systémů, které mají odhalovat a odstraňovat fake news, ale tato technologie často zaostává za schopnostmi systémů, které dezinformace vytvářejí.

Problém je dále komplikován tím, že ne všechny automatizovaně generované zprávy jsou zcela nepravdivé. Mnoho dezinformačních kampaní využívá techniku mixování pravdivých informací s nepravdivými nebo zavádějícími tvrzeními. Tento přístup činí obsah věrohodnějším a ztěžuje jeho identifikaci jako fake news. AI systémy dokážou sofistikovaně manipulovat s kontextem, vybírat selektivně fakta a vytvářet narativy, které podporují určitý úhel pohledu, aniž by nutně obsahovaly přímé lži.

Společenské dopady automatizovaného šíření fake news jsou dalekosáhlé. Ovlivňují volební procesy, podkopávají důvěru v instituce, polarizují společnost a mohou vést k reálným bezpečnostním hrozbám. Dezinformace šířené během zdravotních krizí, jako byla pandemie COVID-19, měly přímý dopad na veřejné zdraví. Falešné informace o vakcinách, léčbě nebo původu nemoci vedly k nebezpečnému chování a ohrozily životy lidí.

Vzdělávání veřejnosti v oblasti mediální gramotnosti se stává klíčovým nástrojem obrany. Lidé potřebují rozumět tomu, jak fungují algoritmy sociálních sítí, jak identifikovat potenciální fake news a jak ověřovat informace z více zdrojů. Je však důležité si uvědomit, že s rostoucí sofistikovaností AI generovaného obsahu se stává stále obtížnější rozpoznat dezinformace i pro zkušené uživatele.

Rozpoznání AI generovaného obsahu a falešných informací

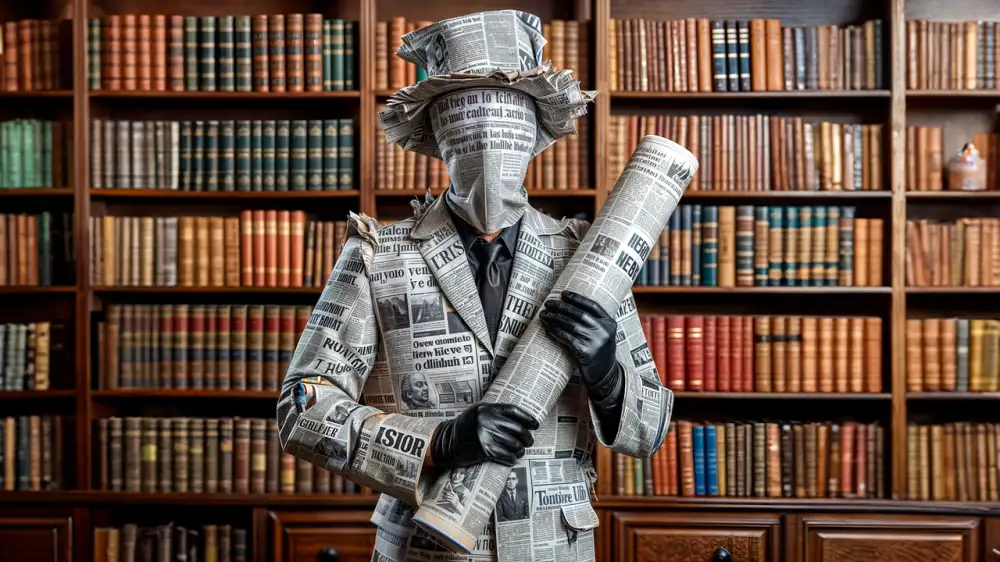

Umělá inteligence se stala nástrojem, který dokáže vytvářet obsah téměř k nerozeznání od toho, co produkují lidé. Tato schopnost s sebou přináší zásadní výzvy v oblasti rozpoznávání pravdivých informací od těch, které byly uměle vygenerovány s cílem manipulovat veřejné mínění nebo šířit dezinformace. V současné době se setkáváme s fenoménem, kdy algoritmy dokážou vytvářet texty, obrázky i videa, která působí autenticky, ale jejich původ a záměr mohou být zcela jiné, než se na první pohled zdá.

Rozpoznání AI generovaného obsahu vyžaduje pečlivou analýzu několika klíčových aspektů. Prvním indikátorem může být neobvyklá konzistence v psaní nebo příliš dokonalá struktura textu, která postrádá přirozené nedokonalosti lidského vyjadřování. Umělá inteligence má tendenci vytvářet obsah, který je gramaticky bezvadný, ale může postrádat hloubku osobních zkušeností nebo emocionálních nuancí, které jsou pro lidské autory typické. Dalším znakem bývá opakování určitých frází nebo formulací, které AI systémy používají jako vzorce při generování textů.

Falešné informace vytvořené pomocí AI představují sofistikovanější formu dezinformací než tradiční fake news. Tyto systémy dokážou vytvářet komplexní narativy, které jsou konzistentní napříč různými platformami a médii. Mohou generovat falešné citace, vytvářet neexistující zdroje nebo manipulovat s kontextem skutečných událostí tak, aby podporovaly určitý narativ. Problém je umocněn tím, že tyto technologie jsou stále dostupnější a jejich používání nevyžaduje pokročilé technické znalosti.

Při ověřování autenticity obsahu je důležité zaměřit se na zdroj informací a jeho důvěryhodnost. AI generovaný obsah často pochází z nově vytvořených profilů na sociálních sítích nebo z webových stránek, které nemají dlouhou historii nebo transparentní informace o autorech. Nedostatek kontaktních údajů, absence redakční politiky nebo chybějící informace o vlastnictví média jsou varovné signály. Skuteční novináři a renomované organizace mají obvykle jasně definovanou strukturu odpovědnosti a historii publikované práce.

Technické aspekty rozpoznávání AI generovaného vizuálního obsahu zahrnují analýzu detailů, které jsou pro současné algoritmy stále problematické. U fotografií a videí to mohou být nepřirozené textury, nekonzistentní osvětlení, podivné proporce lidských postav nebo artefakty v pozadí. Zvláštní pozornost je třeba věnovat rukám, očím a vlasům, které jsou pro AI často náročné k věrnému zobrazení. U deepfake videí může být indikátorem neobvyklé blikání, nepřirozené pohyby rtů nebo nesoulad mezi zvukem a obrazem.

Kritické myšlení zůstává nejdůležitějším nástrojem v boji proti AI generovaným falešným informacím. Je nezbytné klást si otázky ohledně motivace za sdílením určitého obsahu, ověřovat informace z více nezávislých zdrojů a být obezřetný vůči emočně nabitým příspěvkům, které vyzývají k okamžitému sdílení. AI systémy často cílí na emocionální reakce, protože vědí, že lidé mají tendenci sdílet obsah, který vyvolává silné pocity, aniž by jej důkladně prověřili. Vzdělávání v oblasti mediální gramotnosti a porozumění fungování umělé inteligence se stává nezbytnou součástí moderního občanství v digitální společnosti.

V éře umělé inteligence se pravda stává tím, čemu většina lidí uvěří jako prvnímu, nikoliv tím, co odpovídá skutečnosti. Dezinformace vytvořené AI jsou nebezpečné právě proto, že dokonale napodobují realitu a oslovují naše nejhlubší předsudky.

Radovan Šimůnek

Dopady na společnost a demokratické procesy

Umělá inteligence přináší do oblasti dezinformací zcela novou dimenzi, která má dalekosáhlé důsledky pro fungování demokratických společností. Technologie schopné generovat falešné zprávy, manipulované fotografie i videa dosáhly takové úrovně sofistikovanosti, že běžný občan často nedokáže rozlišit pravdivý obsah od fabricovaného materiálu. Tento fenomén, označovaný jako AI fake news, představuje vážné ohrožení pro informační ekosystém, na němž jsou založeny moderní demokratické procesy.

Zatímco tradiční dezinformace vyžadovaly značné lidské úsilí a kreativitu, současné systémy založené na umělé inteligenci dokážou produkovat přesvědčivý falešný obsah v masovém měřítku a v krátkém čase. Generativní modely mohou vytvářet texty napodobující styl renomovaných novinářů, syntetizovat realisticky vypadající fotografie událostí, které se nikdy neodehrály, nebo vytvářet deepfake videa politiků pronášejících projevy, které nikdy neřekli. Tato technologická revoluce v oblasti tvorby obsahu zásadně mění dynamiku šíření dezinformací.

Dopady na demokratické procesy jsou mnohostranné a hluboké. Volební kampaně se stávají zranitelnějšími vůči cíleným dezinformačním kampaním, kdy mohou být voliči vystaveni personalizovaným falešným zprávám přizpůsobeným jejich psychologickému profilu a politickým preferencím. Eroze důvěry v mediální instituce představuje další závažný problém – když se lidé nemohou spolehnout na to, že to, co vidí nebo slyší, je skutečné, začínají zpochybňovat veškeré informace, včetně těch pravdivých. Tento stav nazývaný liar's dividend umožňuje politikům a dalším aktérům odmítat autentické důkazy o jejich pochybení s odůvodněním, že mohly být vytvořeny pomocí AI.

Společenská polarizace se prohlubuje, protože algoritmy umělé inteligence mohou být záměrně využívány k vytváření obsahu, který rozdmýchává emoce a rozděluje komunity. Dezinformace generované AI se šíří rychleji než kdy předtím díky sociálním sítím, jejichž algoritmy upřednostňují virální obsah bez ohledu na jeho pravdivost. Tím vzniká začarovaný kruh, kdy falešné zprávy dosahují většího dosahu než pečlivě ověřené informace z důvěryhodných zdrojů.

Ohrožení veřejné debaty představuje další kritickou oblast dopadu. Když se informační prostor zaplní falešným obsahem, stává se obtížnějším vést konstruktivní diskusi o důležitých společenských otázkách. Občané ztrácejí schopnost formovat informované názory na základě faktů, což je fundamentální předpoklad fungující demokracie. Manipulace veřejného mínění prostřednictvím AI generovaných dezinformací může ovlivnit výsledky referend, voleb i podporu pro konkrétní politická opatření.

Institucionální odpověď na tuto hrozbu zatím zaostává za tempem technologického vývoje. Právní rámce nejsou dostatečně připraveny regulovat automatizovanou tvorbu dezinformací, zatímco technologické nástroje pro detekci AI generovaného obsahu se nacházejí v neustálém závodu s vývojem stále sofistikovanějších generativních systémů. Mediální gramotnost obyvatelstva nedokáže držet krok s rychlostí, jakou se mění povaha dezinformačních hrozeb.

Nástroje a metody pro ověřování pravdivosti zpráv

V současné digitální éře se problematika umělé inteligence a jejího zneužití k šíření dezinformací stává stále naléhavějším tématem. Ačkoliv přesný slovníkový význam výrazu ai fake news není oficiálně kodifikován v českých jazykových příručkách, jedná se o fenomén označujícífalešné nebo zavádějící zprávy vytvořené nebo šířené pomocí technologií umělé inteligence. Tento pojem zahrnuje široké spektrum manipulativních technik, od automaticky generovaných textů přes deepfake videa až po sofistikované algoritmy, které dokážou napodobit lidský styl psaní a vytvářet přesvědčivý, avšak nepravdivý obsah.

Pro efektivní boj proti této moderní formě dezinformací je nezbytné disponovat účinnými nástroji a metodami ověřování pravdivosti zpráv. Prvním krokem v procesu verifikace je kritické myšlení a zdravá skepse vůči informacím, které se jeví příliš senzační nebo emocionálně nabité. Čtenáři by měli vždy zvažovat zdroj informace a ptát se, zda pochází z důvěryhodného média s etablovanou reputací.

Technologické nástroje pro detekci falešných zpráv se rychle vyvíjejí a zahrnují specializované platformy pro fact-checking, které systematicky ověřují tvrzení objevující se ve veřejném prostoru. Tyto služby využívají kombinaci lidských expertů a algoritmů strojového učení k identifikaci nesrovnalostí, logických chyb a faktických nepřesností. Důležitou metodou je také křížová kontrola informací napříč různými zdroji, kdy porovnáváním více nezávislých zpráv lze odhalit rozpory a nekonzistence.

Při ověřování vizuálního obsahu, jako jsou fotografie a videa, existují specializované nástroje pro reverzní vyhledávání obrázků, které umožňují zjistit původní kontext a datum pořízení snímku. Tato technika je zvláště užitečná při odhalování recyklovaného obsahu, kdy staré fotografie jsou prezentovány jako aktuální dokumentace současných událostí. Analýza metadat digitálních souborů může odhalit informace o tom, kdy a kde byl obsah vytvořen, případně zda byl následně upravován.

Moderní detekční systémy využívají pokročilé algoritmy pro rozpoznávání vzorců typických pro AI generovaný obsah. Tyto systémy analyzují lingvistické charakteristiky textu, konzistenci stylu a přítomnost specifických anomálií, které jsou pro umělou inteligenci typické. Například neobvyklé opakování frází, nepřirozené přechody mezi tématy nebo nadměrná formálnost jazyka mohou indikovat automaticky generovaný obsah.

Důležitou součástí verifikačního procesu je také ověřování identity autora a jeho kredibility. Transparentní autoři s ověřenou identitou a profesionální historií jsou obecně důvěryhodnější než anonymní profily nebo nově vytvořené účty. Analýza časové osy publikování může odhalit koordinované kampaně, kdy je stejný nebo podobný obsah masivně šířen v krátkém časovém úseku.

Vzdělávání v oblasti mediální gramotnosti představuje fundamentální pilíř obrany proti dezinformacím. Schopnost rozpoznat manipulativní techniky, jako je používání emotivního jazyka, selektivní prezentace faktů nebo záměrné vynechávání kontextu, je klíčová pro každého občana digitální společnosti. Pravidelné školení a osvěta pomáhají lidem rozvíjet kritické myšlení a odolnost vůči manipulaci.

Legislativa a regulace AI fake news

V současné digitální éře se fenomén umělé inteligence stává stále výraznějším faktorem ovlivňującím šírení informací a dezinformací v online prostoru. Legislativní rámec zabývající se problematikou AI fake news představuje komplexní výzvu pro zákonodárce napříč celým světem, kteří se snaží najít rovnováhu mezi ochranou svobody slova a potřebou chránit společnost před škodlivými dezinformacemi generovanými umělou inteligencí.

| Charakteristika | AI fake news | Tradiční fake news |

|---|---|---|

| Rychlost vytváření | Sekundy až minuty | Hodiny až dny |

| Náklady na produkci | Nízké (automatizované) | Střední až vysoké |

| Kvalita textu | Vysoká, gramaticky správná | Různorodá, často s chybami |

| Personalizace obsahu | Vysoká (cílení na jednotlivce) | Nízká (masové šíření) |

| Detekce | Obtížná, vyžaduje AI nástroje | Snazší, fact-checking |

| Objem produkce | Tisíce článků denně | Desítky článků denně |

| Deepfake videa | Ano, realistická | Ne nebo primitivní |

| Jazyková variabilita | Desítky jazyků současně | Omezená na znalosti autora |

| Adaptabilita | Okamžitá reakce na události | Pomalá adaptace |

Evropská unie se v posledních letech aktivně věnuje vytváření právních nástrojů, které by měly regulovat používání umělé inteligence při tvorbě a šírení nepravdivých informací. Nařízení o umělé inteligenci, známé také jako AI Act, představuje průlomový legislativní krok, který kategorizuje různé typy AI systémů podle míry rizika, které představují pro společnost. Systémy schopné vytvářet realistické deepfake videa nebo textový obsah, který může být zaměněn za skutečné zpravodajství, spadají do kategorie vysokého rizika a podléhají přísnějším regulačním požadavkům.

Problematika definování pojmu AI fake news zůstává jednou z klíčových výzev pro zákonodárce. Absence univerzálního slovníkového významu tohoto výrazu komplikuje tvorbu efektivní legislativy, protože hranice mezi legitimním použitím AI pro tvorbu obsahu a zneužitím této technologie k šírení dezinformací není vždy jednoznačná. Zákonodárci musí pečlivě zvažovat, jak definovat nepravdivé informace generované umělou inteligencí, aniž by přitom omezovali legitimní využití těchto technologií v oblasti satiry, umění nebo vzdělávání.

V České republice se legislativní přístup k této problematice vyvíjí v souladu s evropskými směrnicemi, přičemž národní zákonodárci čelí specifickým výzvám spojeným s implementací mezinárodních standardů do domácího právního řádu. Klíčovým aspektem je vytvoření mechanismů pro identifikaci a označování obsahu vytvořeného umělou inteligencí, což vyžaduje spolupráci mezi technologickými společnostmi, médii a státními orgány.

Regulační orgány se zaměřují na několik základních pilířů. Transparentnost a označování AI generovaného obsahu představuje první linii obrany proti šírení dezinformací. Platformy a tvůrci obsahu by měli být povinni jasně označovat materiály vytvořené nebo významně modifikované umělou inteligencí, aby uživatelé mohli informovaně posoudit důvěryhodnost prezentovaných informací.

Dalším významným aspektem legislativy je odpovědnost poskytovatelů AI služeb za obsah generovaný jejich systémy. Otázka, do jaké míry mohou být technologické společnosti činěny odpovědnými za zneužití jejich nástrojů k tvorbě fake news, zůstává předmětem intenzivních debat. Některé právní systémy prosazují model sdílené odpovědnosti, kde jak vývojáři AI systémů, tak koncoví uživatelé nesou určitý díl zodpovědnosti za šířený obsah.

Sankční mechanismy tvoří nedílnou součást regulačního rámce. Pokuty a další sankce za úmyslné šírení AI generovaných dezinformací musí být dostatečně odrazující, aby efektivně zabránily zneužívání těchto technologií, zároveň však nesmí být tak přísné, aby bránily inovacím a legitimnímu využití umělé inteligence. Vymahatelnost těchto pravidel představuje další praktickou výzvu, zejména v kontextu globální povahy internetu a možnosti šířit dezinformace přes hranice jurisdikcí.

Mezinárodní spolupráce je klíčová pro efektivní regulaci AI fake news, protože dezinformace nerespektují státní hranice. Koordinace mezi různými zeměmi při vytváření kompatibilních legislativních rámců a sdílení osvědčených postupů při detekci a potírání AI generovaných dezinformací je nezbytná pro úspěšné řešení této globální výzvy.

Mediální gramotnost a vzdělávání veřejnosti

Mediální gramotnost představuje v současné digitální éře jeden z nejzásadnějších nástrojů obrany proti dezinformacím šířeným prostřednictvím umělé inteligence. Vzdělávání veřejnosti v oblasti rozpoznávánífalešných zpráv generovaných AI se stává neodkladnou prioritou pro celou společnost, protože technologie vytváření realisticky vypadajícího obsahu dosáhla úrovně, kdy běžný uživatel internetu často nedokáže rozlišit pravdivou informaci od sofistikované manipulace.

Vzdělávací instituce čelí výzvě, jak efektivně připravit studenty na svět, ve kterém umělá inteligence dokáže vytvářet texty, obrázky, videa i zvukové nahrávky, jež jsou k nerozeznání od skutečného obsahu vytvořeného člověkem. Tradiční přístupy k mediální výchově, které se zaměřovaly především na kritické hodnocení tištěných médií a televizního vysílání, již nejsou dostatečné. Moderní mediální gramotnost musí zahrnovat porozumění tomu, jak fungují algoritmy sociálních sítí, jaké jsou možnosti generativní umělé inteligence a především jaké techniky lze využít k ověřování autenticity digitálního obsahu.

Veřejné knihovny, komunitní centra a vzdělávací organizace by měly pravidelně pořádat workshopy a semináře zaměřené na praktické dovednosti v oblasti digitální hygieny. Účastníci těchto programů by se měli naučit pracovat s nástroji pro ověřování faktů, rozpoznávat typické znaky AI generovaného obsahu a chápat kontext, ve kterém se dezinformace šíří. Důležitou součástí vzdělávání je také psychologický aspekt, tedy pochopení toho, proč jsou lidé náchylní věřit falešným zprávám a jak emocionální manipulace ovlivňuje naše vnímání informací.

Školní osnovy by měly integrovat mediální gramotnost jako průřezové téma napříč všemi předměty, nikoli pouze jako izolovaný modul. Studenti potřebují pravidelně procvičovat kritické myšlení při práci s různými typy zdrojů informací. Pedagogové by měli být proškoleni v nejnovějších trendech v oblasti AI technologií a dezinformačních kampaní, aby dokázali studentům poskytnout aktuální a relevantní vedení.

Klíčovou roli hraje také mezigenerační vzdělávání, protože starší generace často nemají dostatečné technické znalosti k rozpoznání pokročilých forem digitální manipulace. Programy, kde mladší lidé sdílejí své digitální dovednosti se staršími členy rodiny, mohou vytvořit efektivní síť vzájemné podpory a ochrany před dezinformacemi. Důležité je zdůraznit, že mediální gramotnost není jednorázová záležitost, ale kontinuální proces učení, který musí reagovat na neustále se vyvíjející technologie a metody šíření falešných informací.

Veřejnoprávní média mají odpovědnost pravidelně informovat o nových formách AI generovaných dezinformací a poskytovat divákům praktické tipy, jak se chránit. Transparentní komunikace o tom, jak fungují redakční procesy a jak se ověřují informace před publikací, může posílit důvěru veřejnosti v kvalitní žurnalistiku a pomoci lidem rozlišit mezi seriózními zdroji a pochybnými weby šířícími falešné zprávy.

Budoucnost AI a boj proti dezinformacím

Umělá inteligence představuje v současné době jeden z nejdynamičtěji se rozvíjejících technologických fenoménů, který zásadním způsobem ovlivňuje podobu informačního prostředí a způsob, jakým lidé přistupují k obsahu na internetu. V kontextu narůstajícího množství dezinformací a manipulativního obsahu se AI fake news stává klíčovým termínem, který popisuje problematikufalešných zpráv generovaných nebo šířených pomocí algoritmů umělé inteligence. Slovník význam výrazu ai fake news sice není k dispozici v tradiční podobě, avšak samotný koncept se rychle etabluje jako označení pro sofistikované techniky vytváření nepravdivého obsahu, který je stále obtížněji rozpoznatelný od autentických informací.

Technologický pokrok v oblasti generativní umělé inteligence přinesl bezprecedentní možnosti pro tvorbu realisticky vypadajících textů, obrázků, audio nahrávek i videí. Deepfake technologie dokáže vytvořit videozáznamy, ve kterých veřejně známé osobnosti pronášejí výroky, které ve skutečnosti nikdy neřekly. Jazykové modely jsou schopny produkovat články, které svou strukturou a stylem napodobují práci profesionálních novinářů. Tato schopnost AI generovat přesvědčivý, ale nepravdivý obsah představuje zásadní výzvu pro mediální gramotnost a kritické myšlení současné společnosti.

Budoucnost AI a boj proti dezinformacím spočívá v paradoxní situaci, kdy stejná technologie, která umožňuje vytváření falešného obsahu, může být zároveň využita k jeho odhalování a potírání. Výzkumné instituce a technologické společnosti intenzivně pracují na vývoji detekčních algoritmů, které dokážou identifikovat stopy umělé manipulace v digitálním obsahu. Tyto systémy analyzují drobné nesrovnalosti v pixelech obrazu, nekonzistence v osvětlení, nepřirozené pohyby nebo artefakty vznikající při generování syntetického obsahu.

Komplexní přístup k řešení problematiky AI fake news vyžaduje kombinaci technologických, legislativních a vzdělávacích opatření. Platformy sociálních médií implementují stále sofistikovanější nástroje pro automatickou moderaci obsahu a označování potenciálně zavádějících příspěvků. Evropská unie a další regulatorní orgány pracují na právních rámcích, které by stanovily jasná pravidla pro transparentnost AI generovaného obsahu a sankce za záměrné šíření dezinformací.

Vzdělávání veřejnosti v oblasti digitální gramotnosti se stává nezbytnou součástí moderního školství. Lidé potřebují rozumět tomu, jak fungují algoritmy, které kurátorují jejich informační prostředí, a musí být vybaveni nástroji pro kritické hodnocení zdrojů informací. Schopnost rozpoznat manipulativní techniky, ověřovat fakta prostřednictvím důvěryhodných zdrojů a pochopit kontext informací představuje základní dovednost pro orientaci v digitálním světě ovládaném umělou inteligencí.

Mezinárodní spolupráce v oblasti výzkumu a regulace AI technologií hraje klíčovou roli v efektivním boji proti dezinformacím. Výměna poznatků mezi akademickými institucemi, technologickými společnostmi a vládními agenturami umožňuje rychlejší identifikaci nových hrozeb a vývoj účinných protiopatření. Transparentnost algoritmů a etické standardy pro vývoj AI systémů jsou fundamentálními požadavky, které by měly být zakotveny v mezinárodních dohodách a průmyslových normách.

Publikováno: 14. 05. 2026

Kategorie: Mediální kritika